Radiology:脑MRI肿瘤检测模型的半监测训练

2022-04-16 shaosai MedSci原创

随着人工智能的飞速发展,人们越来越意识到在影像成像中实现对肿瘤位置的机器认知,其价值远远超过潜在的计算机辅助检测应用。

现阶段,癌症成像的人工智能(AI)应用在概念上始于自动肿瘤检测,这为下游的AI任务提供了基础的技术支持。因此,在影像成像中实现对肿瘤位置的机器认知,其价值远远超过潜在的计算机辅助检测应用。然而,在开发强大的肿瘤检测模型方面仍然存在多种挑战。

现阶段,癌症成像的人工智能(AI)应用在概念上始于自动肿瘤检测,这为下游的AI任务提供了基础的技术支持。因此,在影像成像中实现对肿瘤位置的机器认知,其价值远远超过潜在的计算机辅助检测应用。然而,在开发强大的肿瘤检测模型方面仍然存在多种挑战。

为了解决普遍性的困难,放射学人工智能界正在进行一些努力以鼓励大型的、多机构的图像训练数据集的开发及使用。利用现有工作流程中不断产生的图像注释,临床上提出了一个潜在的解决方案。对储存在临床图片存档和通信系统(PACS)中的现有肿瘤线注释进行数据挖掘,可以暴露出大量的注释数据集,但这带来了数据噪音、不完整的图像标签以及对挖掘的数据进行全面的人工质量保证的可行性等多项挑战。

近日,发表在Radiology杂志的一项研究探讨了临床生成的图像注释是否可以从PACS中进行数据挖掘,并用于半监测的脑MRI肿瘤检测模型的训练。

在本项回顾性研究中,癌症中心的PACS对2012年1月至2017年12月期间获得的脑部MRI扫描进行了挖掘,包括所有注释的强化后的轴位T1图像。所得的方框被用于使用RetinaNet和Mask区域卷积神经网络(R-CNN)架构的物体检测模型的监督训练。从挖掘的数据集中训练出来的表现最好的模型被用来检测训练图像本身的未标记的肿瘤(自我标记),并自动纠正许多丢失的标签。在自我标记之后,使用这个扩大的数据集训练新的模型。使用由100名患者的754张手动标记的图像组成的测试数据集(403个轴内肿瘤和56个轴外增强肿瘤)对模型的精确度、召回率和F1进行评分。使用自举重样法对模型的F1得分进行了比较。

PACS查询提取了31 150行注释,产生了11 880个符合纳入标准的方框。这个挖掘出来的数据集被用来训练模型,RetinaNet的F1分数为0.886,Mask R-CNN为0.908。自我标记增加了18 562个训练盒,使模型的F1分数分别提高到0.935(P<0.001)和0.954(P<0.001)。

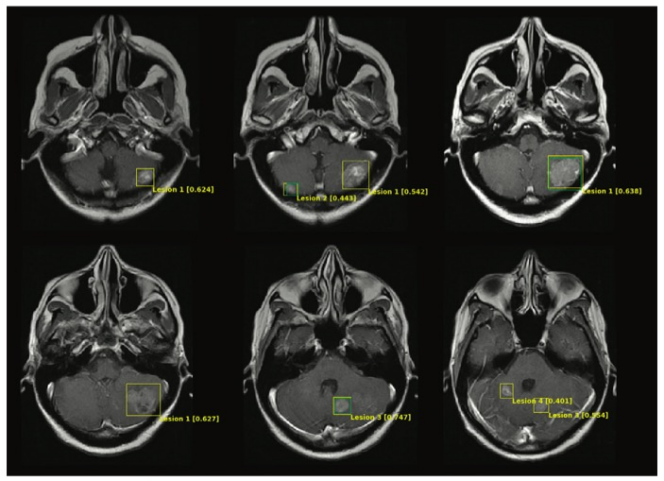

图 自动连接相邻的二维方框后的三维病变识别示例。从一个MRI系列中的几个连续的测试图像中模拟了模型在一整堆连续的轴位强化后T1加权图像上的表现。黄色方框表示基于Mask区域的卷积神经网络模型在自我标记后的预测结果。每个预测框包括一个自动生成的病变识别和信心分数。绿色方框表示从挖掘的肿瘤线注释中产生的基础事实注释

本项调查表明,从PACS中挖掘出来的临床图像注释可用于半监督训练脑部MRI肿瘤检测模型的应用,且性能优异。通过最后的后处理步骤实现的对肿瘤的机器认知,将被用于下游的人工智能任务,其中包括肿瘤分割、分类和治疗反应的评估。此外,这种半监督学习方法可应用于其他放射成像模式,以正式评估其跨模式的扩展性及其在整个系统的肿瘤检测能力的潜力。

原文出处:

Nathaniel C Swinburne,Vivek Yadav,Julie Kim,et al.Semisupervised Training of a Brain MRI Tumor Detection Model Using Mined Annotations.DOI:10.1148/radiol.210817

作者:shaosai

版权声明:

本网站所有注明“来源:梅斯医学”或“来源:MedSci原创”的文字、图片和音视频资料,版权均属于梅斯医学所有。非经授权,任何媒体、网站或个人不得转载,授权转载时须注明“来源:梅斯医学”。其它来源的文章系转载文章,本网所有转载文章系出于传递更多信息之目的,转载内容不代表本站立场。不希望被转载的媒体或个人可与我们联系,我们将立即进行删除处理。

在此留言

#肿瘤检测#

99

不断学习

71

坚持学习

82